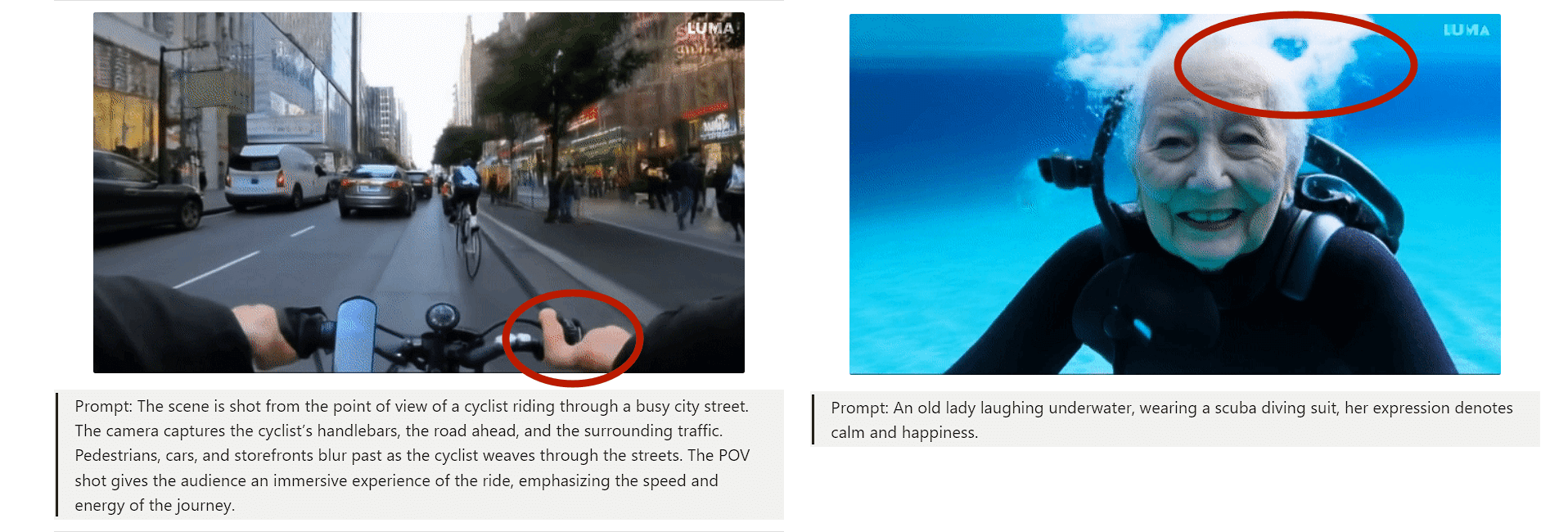

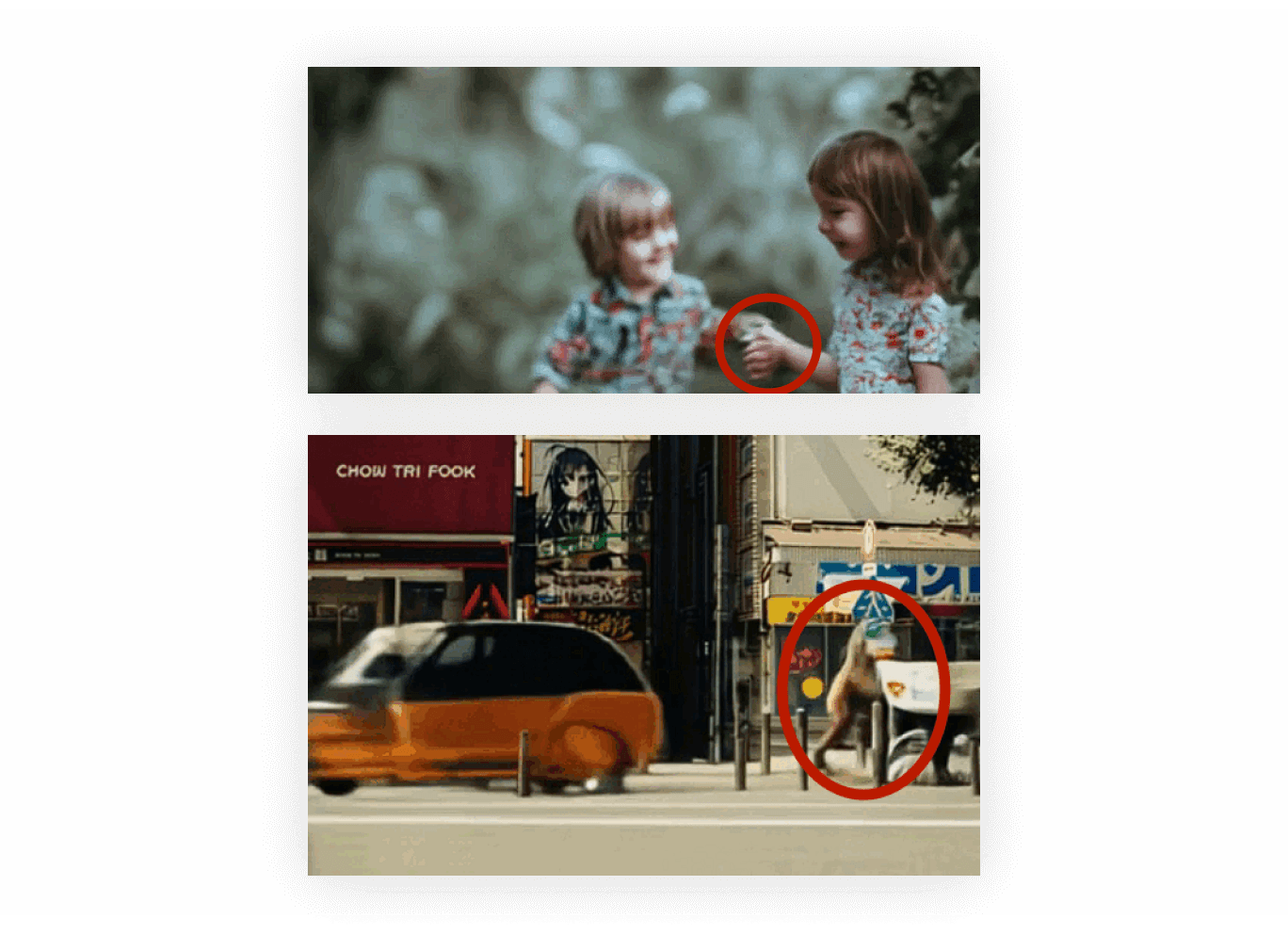

Во многих ИИ-сервисах для генерации картинок есть функция создания видео, но чаще всего результат получается «кривым». Например, пока автомобиль едет по дороге, у него несколько раз изменится форма фар, а у идущего по улице человека — цвет глаз или объем бровей.

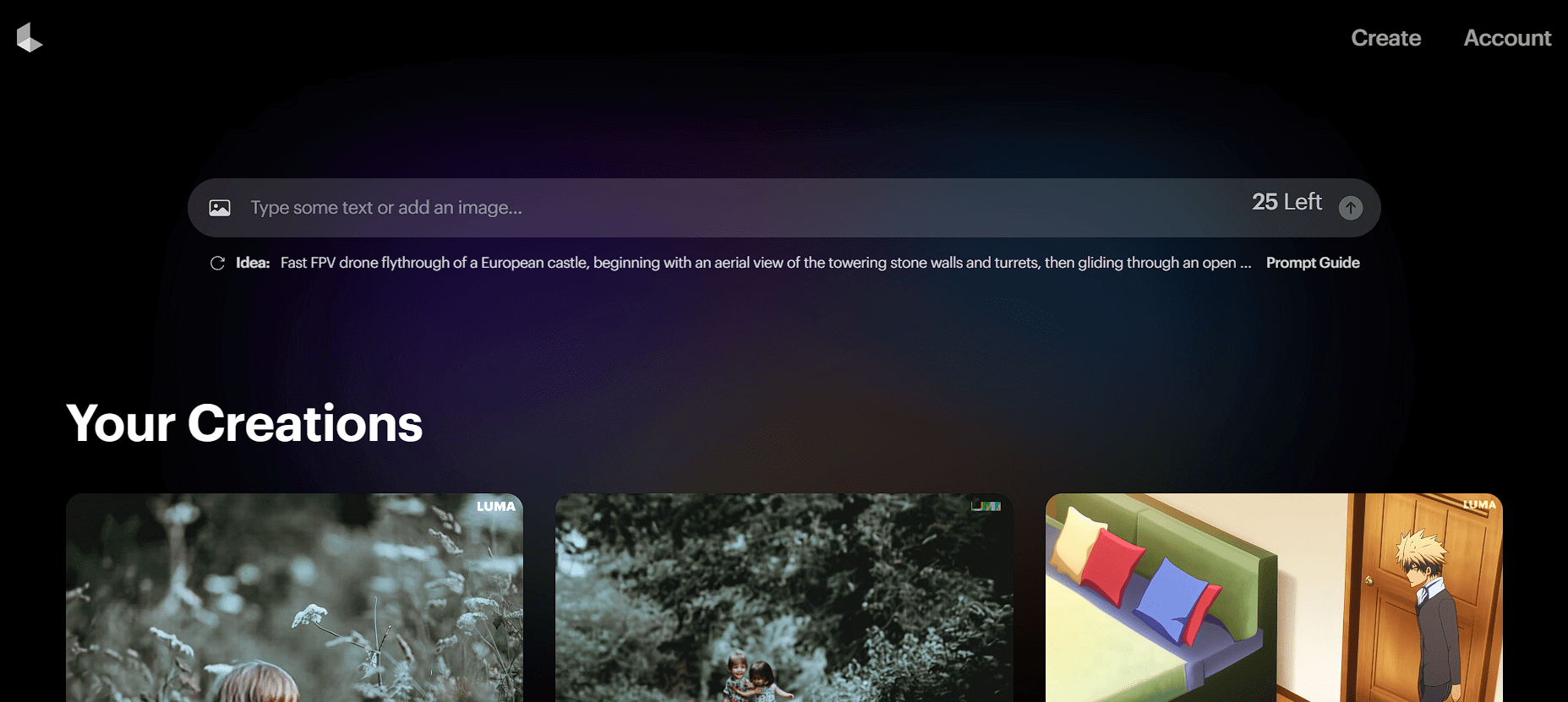

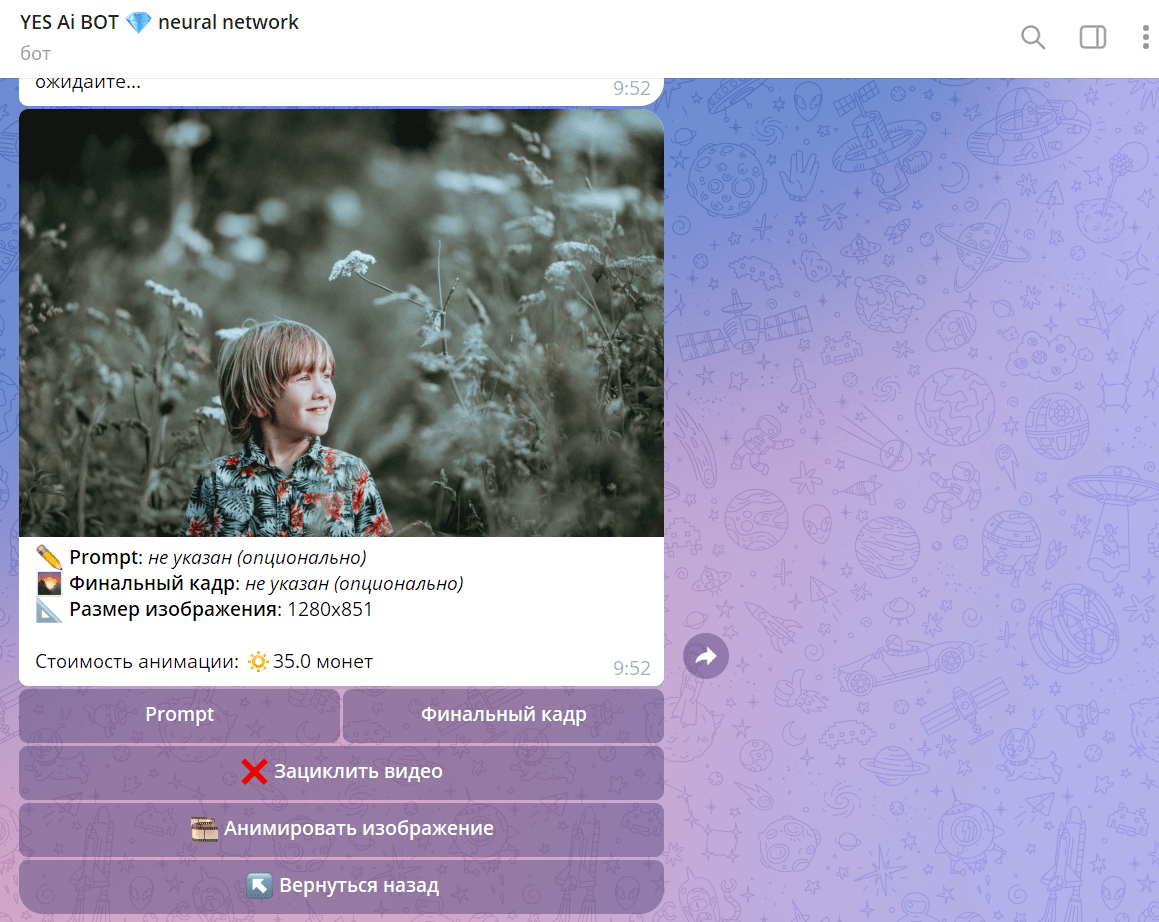

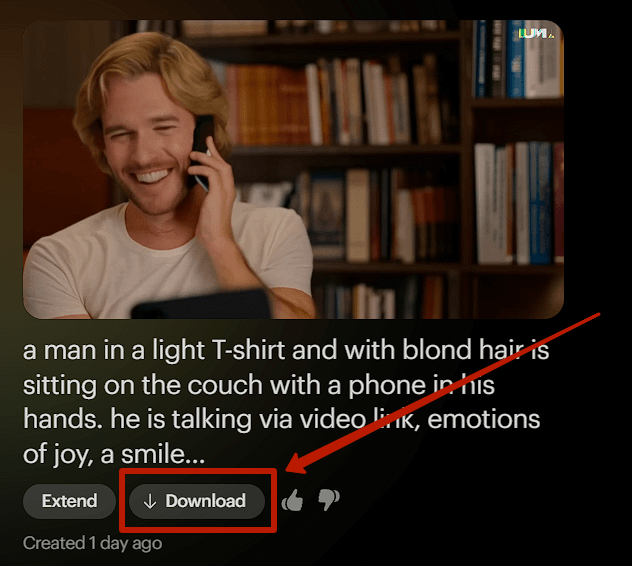

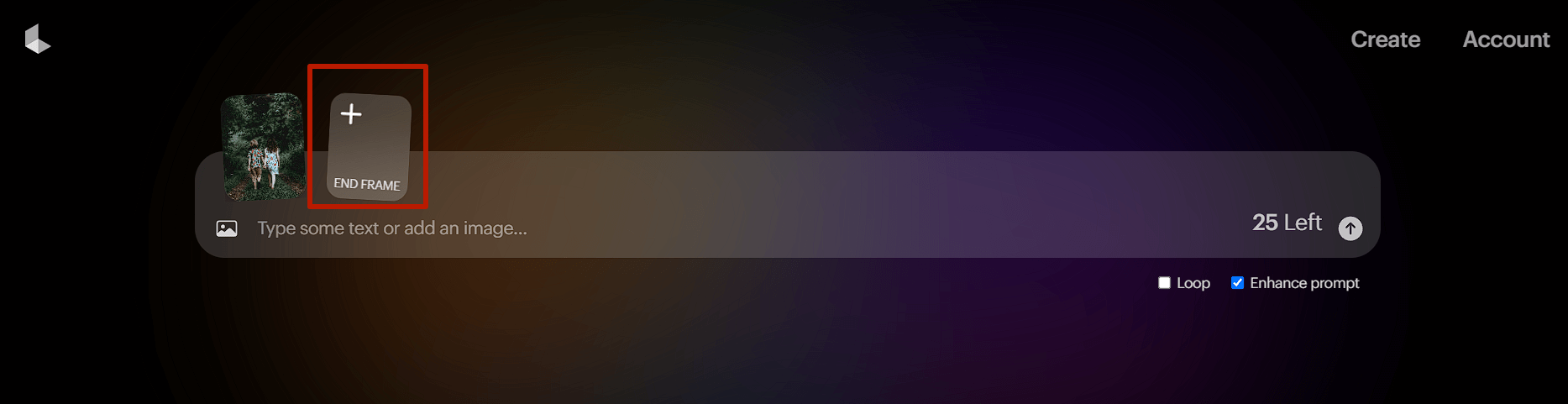

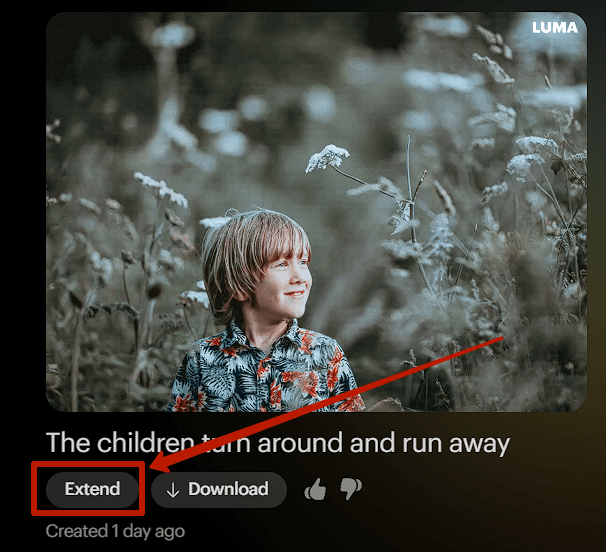

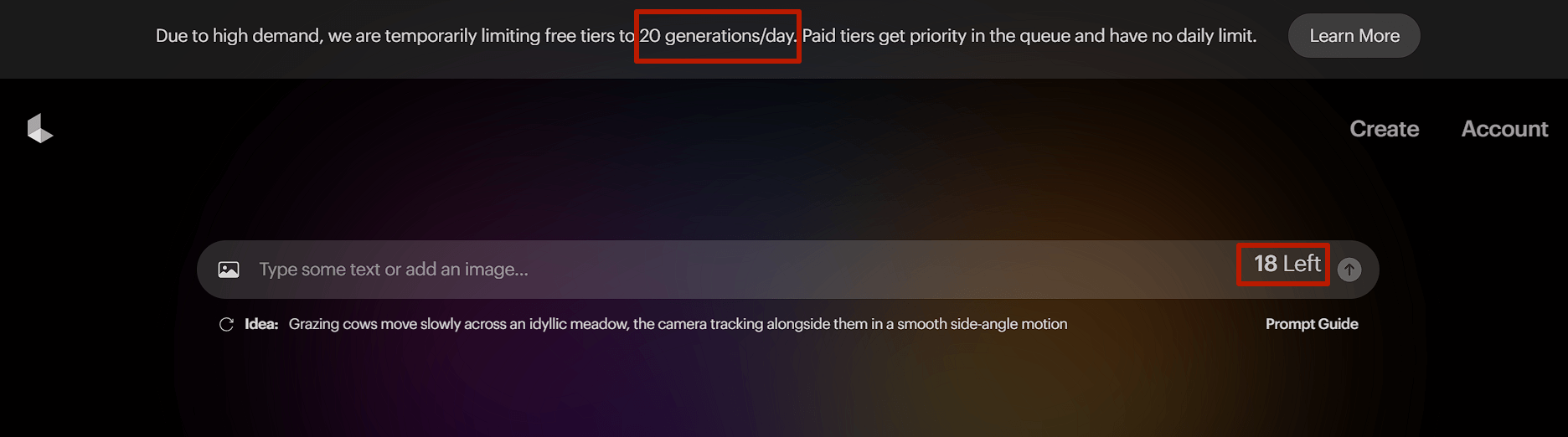

Решить эту проблему можно с помощью Dream Machine от компании Luma — это нейросеть, которая создает бесшовные видео. В статье расскажем, из каких характеристик состоит идеальный промпт и покажем, как создать короткий и длинный ролик по тексту и по картинке.